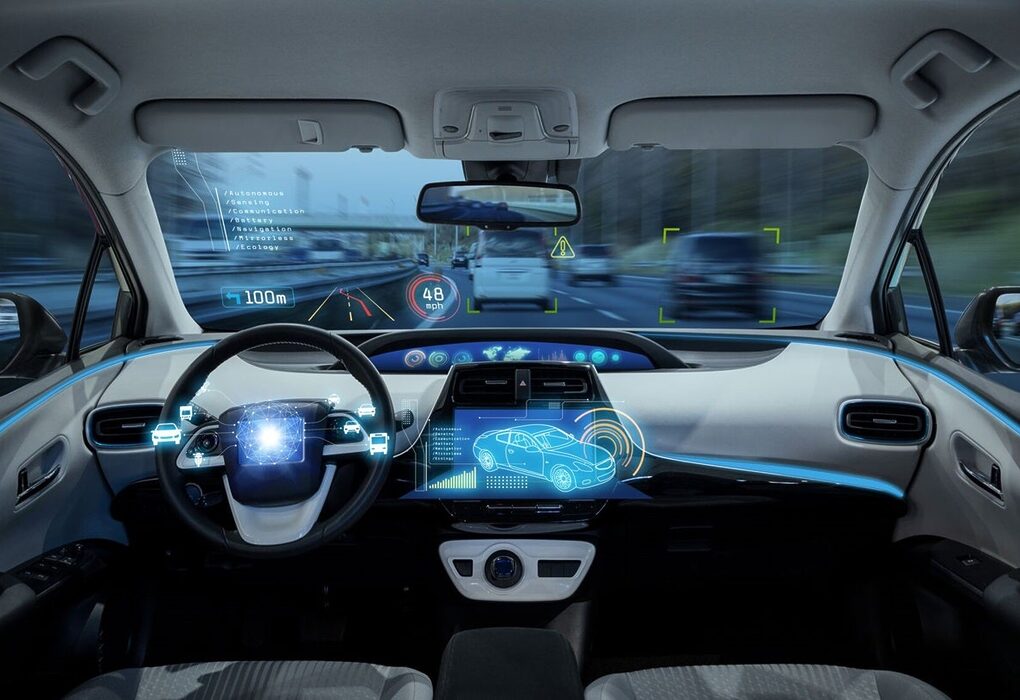

L’assistant IA embarqué change de dimension. Amazon et Nvidia veulent donner aux constructeurs les moyens d’intégrer des assistants conversationnels capables de traiter certaines demandes directement dans le véhicule, avec des essais chez les marques attendus début 2027. L’objectif est limpide : une interface vocale plus réactive, plus juste et mieux calée sur ce qui se passe réellement à bord.

Une base commune pour les constructeurs

Le partenariat associe Alexa Custom Assistant d’Amazon à la plateforme de calcul automobile DRIVE AGX de Nvidia. Pas question ici d’un assistant générique. Chaque constructeur doit pouvoir façonner une interface vocale à son image, construite sur Alexa+ et enrichie de ses propres agents d’intelligence artificielle.

L’architecture repose sur un mélange de traitement local dans la voiture et de fonctions dans le cloud. Le calcul embarqué doit raccourcir les temps de réponse. À distance, la connexion prend le relais pour des services complémentaires comme le streaming musical, la réservation de prestations ou la gestion de la maison connectée. L’ensemble doit aussi rester compatible avec les systèmes d’infodivertissement déjà en place.

Une IA plus attentive à l’habitacle

L’ambition dépasse la simple commande vocale. La technologie vise une IA conversationnelle plus pertinente, grâce à une conscience de l’environnement et à une meilleure compréhension du contexte. En clair, l’assistant peut interpréter des conversations de groupe et ajuster ses réponses selon les conditions à bord.

Anes Hodžić, vice-président d’Amazon Smart Vehicles, résume la logique du projet : « Grâce à notre travail avec Nvidia, nous avons constaté les capacités extraordinaires de la technologie de Nvidia lorsqu’elle est associée à l’Alexa Custom Assistant d’Amazon, soutenu par une pile technologique multimodale, multi-modèle et multi-agent, à la fois en local et dans le cloud. »

L’intégration à DRIVE AGX permet aussi d’exécuter des modèles d’IA optimisés dans le véhicule, sans couper l’accès aux fonctions hébergées à distance. Cela inclut les services Alexa+ liés aux achats, au divertissement et aux interactions de service, via des interfaces personnalisées par les constructeurs.

Rapidité, personnalisation et confidentialité

Pour les constructeurs, cet assistant IA embarqué doit surtout trouver le bon dosage entre intelligence embarquée et services connectés. C’est ce point d’équilibre qui doit fluidifier l’usage au quotidien, sans imposer une refonte complète de l’écosystème numérique déjà présent dans les voitures.

Rishi Dhall, vice-président automobile de Nvidia, met en avant un autre enjeu : « En combinant l’IA conversationnelle d’Amazon avec le calcul accéléré de Nvidia, nous pouvons offrir une expérience embarquée à la fois profondément intelligente et intrinsèquement privée, exactement ce dont les constructeurs ont besoin pour déployer une IA à laquelle leurs clients peuvent faire confiance. »

Le calendrier, lui, reste mesuré, avec des tests attendus chez les constructeurs au début de 2027. Une chose se précise déjà : l’assistant vocal automobile ne se limite plus à exécuter une commande. Il cherche désormais à comprendre l’habitacle, ses occupants et le contexte d’usage, tout en restant ancré dans l’architecture du véhicule.

Restez informé

Suivez-nous sur Google Actualités